Bevezetés a neurális hálózat osztályozásába

A neurális hálózatok a leghatékonyabb módszer (igen, jól olvasod) a valós világbeli problémák megoldására a mesterséges intelligencia területén. Jelenleg ez a számítástechnika egyik legszélesebb körben vizsgált területe, hogy a neurális hálózat új formáját kidolgozták volna, amíg ezt a cikket olvassa. Több száz neurális hálózat létezik a különböző területekre jellemző problémák megoldására. Itt a különféle alapvető idegi hálózatokon keresztül járunk el, a növekvő bonyolultság szerint.

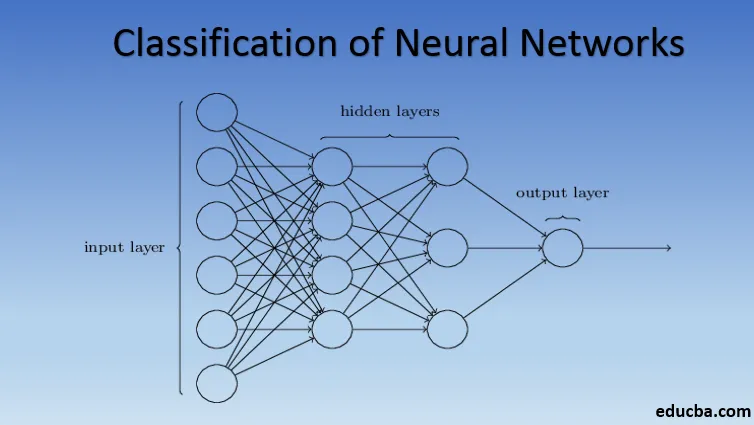

Az ideghálózatok osztályozásának alapjai különféle típusai

1. Sekély neurális hálózatok (együttműködő szűrés)

A neurális hálózatok Perceptron csoportokból készülnek, hogy szimulálják az emberi agy idegrendszerét. A sekély ideghálózatok egyetlen rejtett réteggel rendelkeznek a perceptronon. A sekély ideghálózatok egyik leggyakoribb példája az együttműködési szűrés. Az perceptron rejtett rétegét kiképzik az entitások közötti hasonlóságok ábrázolására az ajánlások előállítása érdekében. A Netflix, az Amazon, a YouTube stb. Ajánlásrendszere a Collaborative szűrés verzióját használja a termékek érdeklődésének megfelelő ajánlásához.

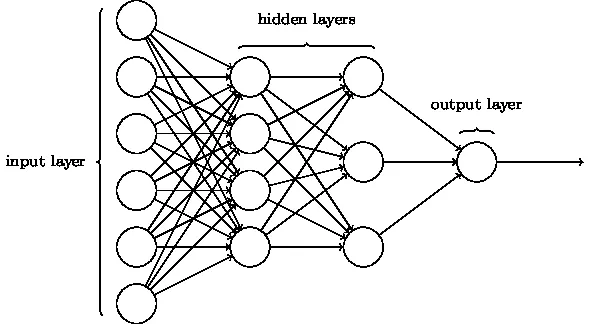

2. Többrétegű perceptron (mély neurális hálózatok)

Az egynél több rejtett réteggel rendelkező neurális hálókat Deep Neural Networks néven hívják. Spoiler figyelmeztetés! Az összes alábbi neurális hálózat egy olyan mély neurális hálózat egyik formája, amelyet módosítottak / fejlesztettek a domain-specifikus problémák kezelésére. Általában segítenek minket az egyetemesség elérésében. Tekintettel arra, hogy elég sok a neuron rejtett rétege, a mély idegi hálózat megközelíthetõ, azaz megoldhat minden összetett valós problémát.

Az univerzális közelítés tétel a mély idegi hálózatok középpontjában áll, hogy bármilyen modellt kiképezzenek és illeszkedjenek. A mély idegi hálózat minden változatát a mátrixszorzás maximálisan összekapcsolt termékének teljesen összekapcsolt rétege fejleszti ki, amelyet a hátsó szaporodási algoritmusok optimalizálnak. Folytatjuk a továbbfejlesztéseket, amelyek a mély idegi hálózatok különböző formáit eredményezik.

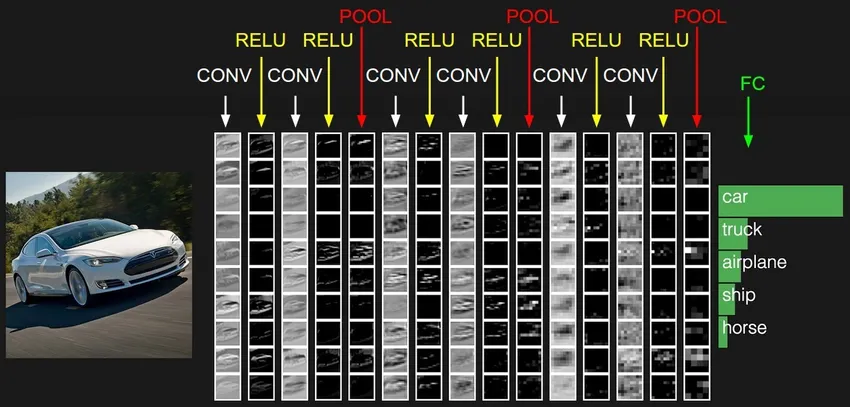

3. Konvolúciós neurális hálózat (CNN)

A CNN-k a mély ideghálózatok legérettebb formái, amelyek a legpontosabb, azaz az emberi eredményeknél jobb eredményeket eredményeznek a számítógépes látásban. A CNN-k olyan konvolúciós rétegekből készülnek, amelyek az adatkészlet minden képpontjának beolvasásával készültek. Amint az adatok rétegekből megközelítésre kerülnek, a CNN elkezdi felismerni a mintákat, és ezáltal felismeri a képekben lévő objektumokat. Ezeket az objektumokat széles körben használják az azonosításhoz, osztályozáshoz és különféle alkalmazásokhoz. A legújabb gyakorlatok, például a CNN-ben történő átviteli tanulás, a modellek pontatlanságának jelentős javulásához vezettek. A Google Translator és a Google Lens a CNN-ek legkorszerűbb példája.

A CNN-k használata exponenciális, mivel azokat olyan problémák megoldásában is használják, amelyek elsősorban nem kapcsolódnak a számítógépes látáshoz. A CNN-k nagyon egyszerű, de intuitív magyarázata itt található.

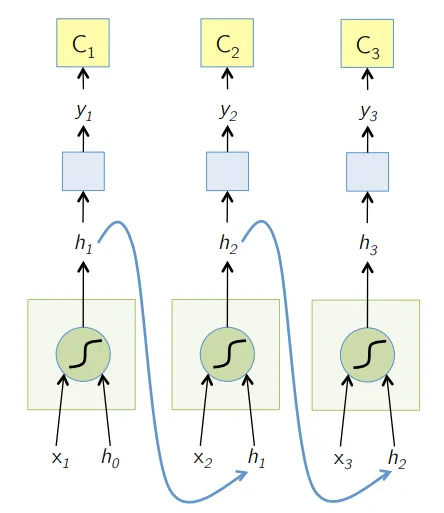

4. Ismétlődő neurális hálózat (RNN)

Az RNN-k a mély neurális hálózatok legújabb formája az NLP problémáinak megoldására. Egyszerűen fogalmazva: az RNN-k néhány rejtett réteg kimenetét továbbítják a bemeneti réteghez, hogy aggregálódjanak, és a közelítést átvigyék a bemeneti adatkészlet következő iterációjára (korszakára). Ezenkívül elősegíti a modell öntanulását, és bizonyos mértékben gyorsabban kijavítja az előrejelzéseket. Az ilyen modellek nagyon segítenek a szöveg szemantikájának megértésében az NLP műveletek során. Az RNN-eknek különböző változatai vannak, mint például a hosszú távú memória (LSTM), a kapu ismétlődő egység (GRU) stb. Az alábbi ábra az h1 és a h2 aktiválását az x2 és x3 bemenetekkel táplálja.

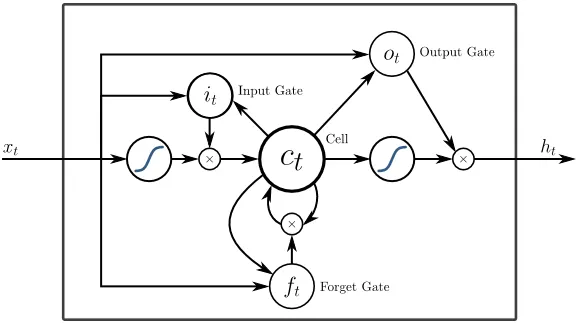

5. Hosszú távú memória (LSTM)

Az LSTM-eket kifejezetten az RNN eltűnő gradiens problémájának kezelésére fejlesztették ki. Az eltűnő gradiensek nagy idegi hálózatokkal fordulnak elő, ahol a veszteségfüggvények gradiensei közelebb kerülnek a nullához, megállítva a neurális hálókat a tanuláshoz. Az LSTM ezt a problémát úgy oldja meg, hogy megakadályozza az aktiválási funkciókat ismétlődő összetevőiben, és a tárolt értékeket nem mutálja. Ez a kis változás nagymértékű javulást eredményezett a végső modellben, amelynek eredményeként a technológiai óriások az LSTM-et adaptálták megoldásukba. Az LSTM „legegyszerűbb magától értetődő” illusztrációjához,

6. Figyelem-alapú hálózatok

A figyelmeztető modellek lassan átveszik a gyakorlatban még az új RNN-ket is. A figyelemfelhívási modellek úgy épülnek fel, hogy az adott információ egy részhalmazára összpontosítanak, ezáltal kiküszöbölik a háttérinformáció túl nagy mennyiségét, amelyre nincs szükség a feladathoz. A figyelmeztető modellek a lágy és a kemény figyelem kombinációjával készültek, és a lágy figyelmet visszaterjesztő képességükkel illeszthetők be. Több, hierarchikusan egymásra rakott modellt Transformernek hívnak. Ezek a transzformátorok hatékonyabban működtetik a halmokat párhuzamosan, és így a legkorszerűbb eredmények viszonylag kevesebb adatot és időt mutatnak a modell kiképzéséhez. A figyelem eloszlása nagyon erős lesz, ha a CNN / RNN-lel együtt használják, és a következőképp képes szöveges leírást adni a képhez.

Az olyan technikai óriások, mint a Google, a Facebook, stb., Gyorsan adaptálják a figyelmi modelleket megoldásaik felépítéséhez.

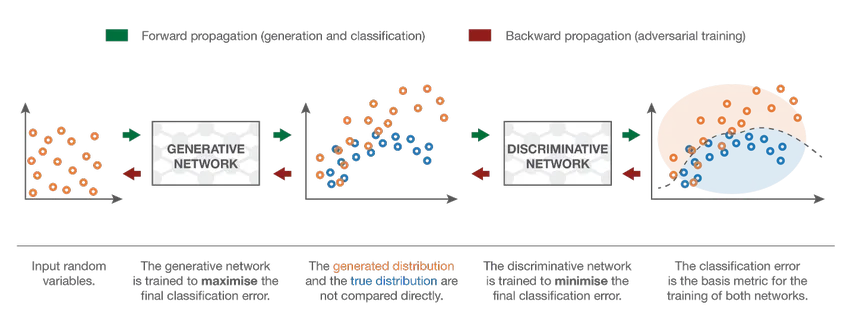

7. Generáló Versenytárs Hálózat (GAN)

Noha a mély tanulási modellek biztosítják a legkorszerűbb eredményeket, sokkal intelligensebb emberi társaik becsaphatják őket azzal, hogy zajt adnak a valós adatokhoz. A GAN-ok az ilyen forgatókönyvek kezelésére szolgáló legújabb fejlemények a mély tanulásban. A GAN-k felügyelet nélküli tanulást alkalmaznak, ahol a mély ideghálózatokat az AI-modell által generált adatokkal, a tényleges adatkészlettel együtt képzik, hogy javítsák a modell pontosságát és hatékonyságát. Ezeket az egymással versengő adatokat főként a diszkriminatív modell becsapására használják az optimális modell felépítése érdekében. Az így kapott modell jobb közelítés, mint képes legyőzni az ilyen zajt. A GAN iránti kutatási érdeklődés olyan kifinomultabb megvalósításokhoz vezetett, mint a Conditional GAN (CGAN), a Laplacian Pyramid GAN (LAPGAN), a Super Resolution GAN (SRGAN) stb.

Következtetés - a neurális hálózat osztályozása

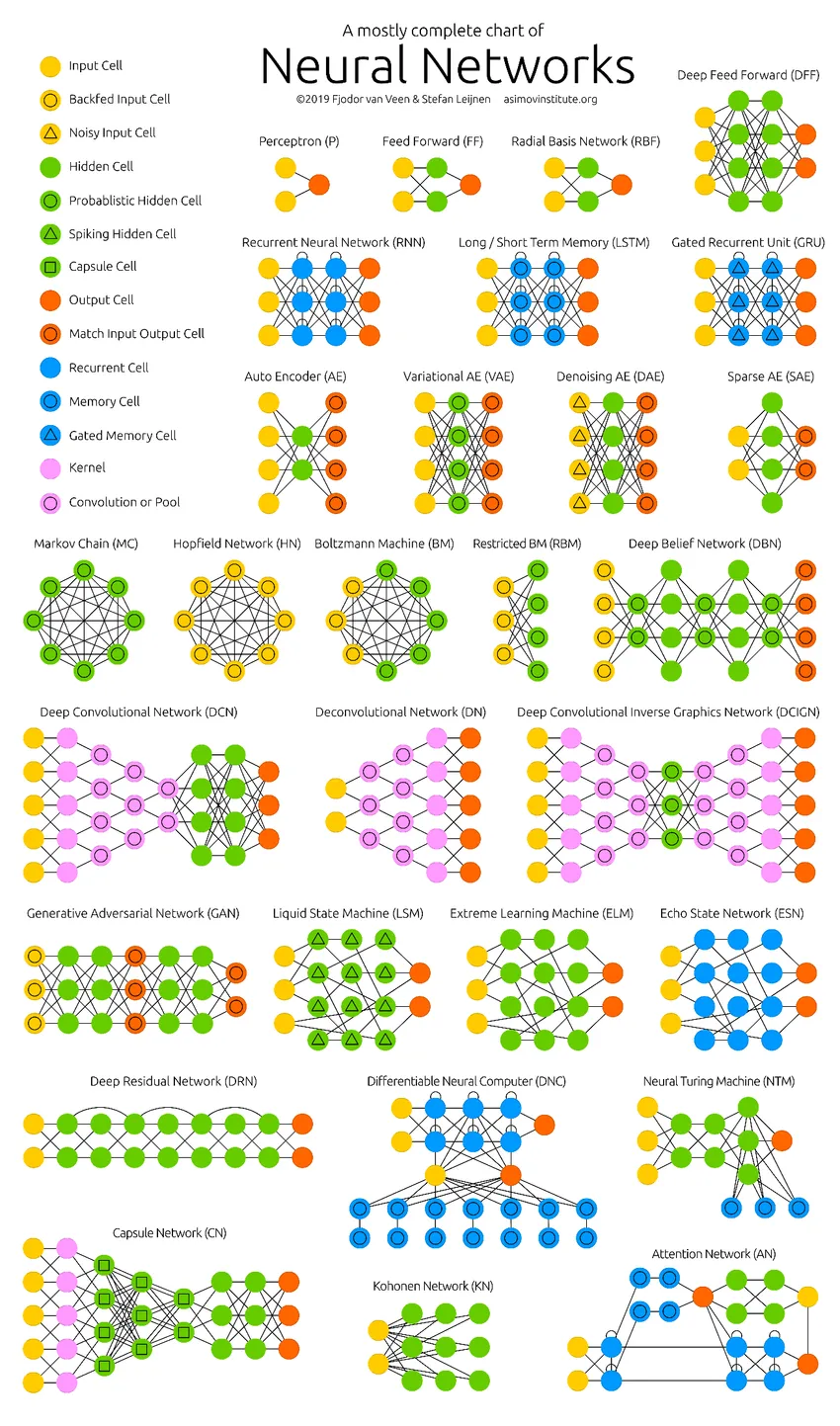

A mély idegi hálózatok a számítógépek határait tolják. Ezek nem csupán a besorolásra (CNN, RNN) vagy az előrejelzésekre (együttműködő szűrés) korlátozódnak, hanem az adatok generálására is (GAN). Ezek az adatok a művészet gyönyörű formájától az ellentmondásos mély hamisításokig változhatnak, mégis napi feladattal meghaladják az embereket. Ezért figyelembe kell vennünk az AI etikáját és hatásait, miközben keményen dolgozunk egy hatékony ideghálózati modell felépítésén. Ideje egy ideális infographic-nak az ideghálózatokról.

Ajánlott cikkek

Ez egy útmutató a neurális hálózat osztályozásához. Itt megvitattuk az alapvető neurális hálózatok különféle típusait. Megnézheti az adott cikkeket is, hogy többet megtudjon-

- Mi az idegháló?

- Neurális hálózati algoritmusok

- Hálózati szkennelő eszközök

- Ismétlődő neurális hálózatok (RNN)

- A 6 legfontosabb összehasonlítás a CNN és az RNN között