A vesztes funkciók áttekintése a gépi tanulásban

Csakúgy, mint a tanárok irányítanak minket, függetlenül attól, hogy jól teljesítünk-e vagy sem az akadémiainkban, a veszteség funkciók ugyanazt a munkát végzik. Ez egy módszer annak felmérésére, hogy algoritmusunk mennyire modellezi az adatokat. A modern gépi tanulásban az veszteségfüggvények képezik az értékelés fő forrását. Amikor megváltoztatja az algoritmust a modell javítása érdekében, a veszteségfüggvény értéke megmondja, hogy halad-e vagy sem. Elsődleges célunk a veszteségfunkció optimalizálással történő csökkentése. Ebben a cikkben megvitatjuk a veszteségfüggvények működését és a veszteségfüggvények különféle típusait.

Hogyan működnek a veszteségfunkciók?

A „veszteség” szó kimondja a büntetést a várt eredmény elérésének elmulasztása miatt. Ha a modellünk szerint a várt értéknél a vártnál nagyobb eltérés van, akkor a veszteség függvény a kimenetet nagyobb számmal adja meg, és ha az eltérés kicsi és sokkal közelebb van a várt értékhez, akkor kisebb számot ad ki.

Ez egy példa, amikor megpróbáljuk előre jelezni a ház eladási árát a metróvárosokban.

| Előre látható

Értékesítési ár (lakban) | Tényleges

Értékesítési ár (lakban) | Eltérés (veszteség) |

| Bangalore: 45 | 0 (Az összes előrejelzés helyes) | |

| Pune: 35 | ||

| Chennai: 40 | ||

| Bangalore: 40 | Bangalore: 45 | 5 lakh Bangalore, 2 lakh Chennai |

| Pune: 35 | Pune: 35 | |

| Chennai: 38 | Chennai: 40 | |

| Bangalore: 43 | 2 lakh Bangalore, 5 lakh for, Pune2 lakh Chennai számára, | |

| Pune: 30 | ||

| Chennai: 45 |

Fontos megjegyezni, hogy az eltérés nagyságának nincs jelentősége, itt a lényeg az, hogy a modellünk által megjósolt érték helyes vagy rossz. A veszteség függvényei eltérnek attól a problémától függően, amelyre a gépi tanulást alkalmazzák. A költségfüggvény egy másik kifejezés, amelyet felváltva használunk a veszteségfüggvényre, de kissé más jelentéssel bír. A veszteségfüggvény egyetlen képzési példára vonatkozik, míg a költségfüggvény az átlagos veszteség a teljes vonat-adatkészlethez képest.

A gépi tanulás veszteségfunkcióinak típusai

Az alábbiakban bemutatjuk a gépi tanulásban a veszteségfüggvény különféle típusait, amelyek a következők:

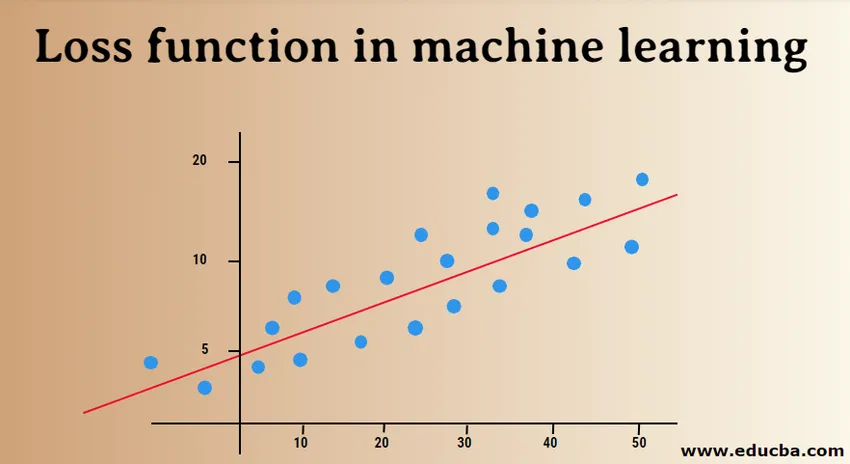

1) Regressziós veszteség függvények:

A lineáris regresszió e funkció alapvető fogalma. A regressziós veszteség függvények lineáris kapcsolatot hoznak létre egy függõ változó (Y) és a független változó (X) között, ezért igyekszünk illeszteni a legjobb sort a térben ezekre a változókra.

Y = X0 + X1 + X2 + X3 + X4 … + Xn

X = független változók

Y = függő változó

- Átlagos négyzet hibavesztés:

Az MSE (L2 hiba) az aktuális és a modell által előre jelzett értékek közti négyzetkülönbséget méri. A kimenet egy szám, amely az értékek halmazához tartozik. Célunk az MSE csökkentése a modell pontosságának javítása érdekében.

Vegyük figyelembe a lineáris egyenletet, y = mx + c, az MSE-t levezethetjük az alábbiak szerint:

MSE = 1 / N ∑i = 1 - n (y (i) - (mx (i) + b)) 2

Itt N az összes adatpont száma, 1 / N ∑i = 1 - n középérték, y (i) pedig a tényleges érték, mx (i) + b pedig a becsült érték.

- Átlagos négyzet logaritmikus hibavesztés (MSLE):

Az MSLE a tényleges és a becsült érték arányát méri. Bevezet egy aszimmetriát a hibagörbébe. Az MSLE csak a tényleges és a becsült értékek százalékos különbségéről gondoskodik. Jó választás veszteségfüggvényként, ha előre akarjuk jósolni a ház eladási árait, a pékség eladási árait, és az adatok folyamatosak.

Itt a veszteség kiszámítható a log-transzformált tényleges és előrejelzett értékek közötti négyzetkülönbségek megfigyelt adatainak átlagaként, amely megadható:

L = 1nnΣi = 1 (log (y (i) +1) -log (y (i) +1)) 2

- Átlagos abszolút hiba (MAE):

A MAE kiszámítja a tényleges és a várható változók közötti abszolút különbségek összegét. Ez azt jelenti, hogy méri a hibák átlagos nagyságát egy előrejelzett értékek halmazában. Az átlagos négyzetes hibát könnyebben lehet megoldani, de az abszolút hiba használata robusztusabb a túlmutatóknál. A külsõ értékek azok az értékek, amelyek rendkívül eltérnek a többi megfigyelt adatponttól.

A MAE kiszámítható:

L = 1nnΣi = 1||y (i) - y (i) ||

2) Bináris osztályozási veszteségfunkciók:

Ezeket a veszteségfüggvényeket az osztályozási modell teljesítményének mérésére szolgálják. Ebben az adatpontokhoz az egyik címke tartozik, azaz 0 vagy 1. Ezenkívül az alábbiak szerint osztályozhatók:

- Bináris kereszt-entrópia

Ez egy alapértelmezett veszteségfunkció a bináris osztályozási problémákhoz. A kereszt-entrópia veszteség kiszámítja egy osztályozási modell teljesítményét, amely 0 és 1 közötti valószínűségi értéket ad ki. A kereszt-entrópia veszteség növekszik, amikor a várható valószínűség eltér az aktuális címkétől.

- Zsanér veszteség

A zsanérveszteség a kereszt-entrópia alternatívájaként használható, amelyet eredetileg egy támogató vektor-gépi algoritmushoz fejlesztettek ki. A zsanérvesztés akkor működik a legjobban, ha osztályozási problémát alkalmazunk, mivel a célértékek a (-1, 1) sorozatban vannak. Ez lehetővé teszi a további hibák hozzárendelését, ha a jel különbség van a tényleges és a becsült értékek között. Így jobb teljesítményt eredményez, mint a kereszt-entrópia.

- Négyzetes zsanérvesztés

A zsanérveszteség kiterjesztése, amely egyszerűen kiszámítja a csuklópánt veszteségének négyzetét. Csökkenti a hiba funkciót, és számszerűen megkönnyíti a munkát. Megtalálja az osztályozási határvonalat, amely meghatározza a különféle osztályok adatpontjai közötti maximális eltérést. A négyzetes zsanérveszteség ideális az IGEN vagy NEM típusú döntési problémákhoz, ahol a valószínűségi eltérés nem gond.

3) Többosztályú osztályozási veszteségfunkciók:

A többosztályú osztályozás olyan prediktív modellek, amelyekben az adatpontok kettőnél több osztályhoz vannak hozzárendelve. Minden osztályhoz egyedi értéket rendelnek 0 és (Number_of_classes - 1) között. Erősen ajánlott kép- vagy szöveges osztályozási problémák esetén, amikor az egyetlen papír több témával foglalkozhat.

- Több osztályú kereszt-entrópia

Ebben az esetben a célértékek 0 és n között vannak, azaz (0, 1, 2, 3 … n). Olyan pontszámot számít, amely átlagos különbséget vesz a tényleges és a várható valószínűségi értékek között, és a pontszámot a lehető legjobb pontosság elérése érdekében minimalizálják. A több osztályú kereszt-entrópia az alapértelmezett veszteségfüggvény a szöveges osztályozási problémák esetén.

- Ritka többosztályú kereszt-entrópia

Egy forró kódolási folyamat megkönnyíti a többosztályú kereszt-entrópiát számos adatpont kezelésekor. A ritka kereszt-entrópia ezt a problémát úgy oldja meg, hogy a hiba kiszámítását elvégzi egy forró kódolás nélkül.

- Kullback Leibler eltérési veszteség

A KL divergencia veszteség kiszámítja a valószínűség-eloszlás és az alap-eloszlás közötti eltérést, és megállapítja, hogy mennyi információ veszik el bitekben. A kimenet nem negatív érték, amely meghatározza, hogy milyen szoros a két valószínűség-eloszlás. A KL eltérésének valószínűségi szempontból történő leírására a valószínűségi arányt használjuk.

Ebben a cikkben kezdetben megértettük, hogy a veszteségfüggvények hogyan működnek, majd tovább vizsgáltuk a veszteségfüggvények átfogó listáját, a használt esetek példáival együtt. Ennek gyakorlati megértése azonban előnyösebb, ezért próbáljon meg többet olvasni és megvalósítsa. Ez alaposan tisztázza kétségeit.

Ajánlott cikkek

Ez egy útmutató a gépi tanulás veszteségfunkcióihoz. Itt tárgyaljuk, hogyan működnek a veszteségfunkciók, és a veszteségtípusokat a gépi tanulásban. Lehet, hogy megnézi a következő cikkeket is, ha többet szeretne megtudni -

- Gépi tanulási módszerek

- Bevezetés a gépi tanulásba

- Big Data Technologies

- Big Data Analytics szoftver

- Ismerje meg a hiperparaméter kategóriáit

- Gépi tanulás életciklusa A 8 legfontosabb szakasz