Különbség a Hadoop és a Spark között

A Hadoop egy nyílt forráskódú keret, amely lehetővé teszi a nagy adatok tárolását és feldolgozását elosztott környezetben a számítógépek klaszterein keresztül. A Hadoop célja, hogy egyetlen kiszolgálón több ezer gépre bővüljön, ahol minden gép helyi számítást és tárolást kínál. A Spark egy nyílt forrású fürtszámítás, amelyet a gyors számításhoz terveztek. Interfészt biztosít a teljes fürt programozására implicit adat-párhuzamossággal és hibatűréssel. A Spark fő jellemzője a memóriában lévő fürtszámítás, amely növeli az alkalmazás sebességét.

Hadoop

- A Hadoop az Apache szoftver alapítvány bejegyzett védjegye. Egy egyszerű programozási modellt alkalmaz a klaszterek közötti szükséges művelet végrehajtására. A Hadoop összes modulját alapvető feltételezéssel tervezték, hogy a hardverhibák gyakori előfordulások, és ezeket a kerettel kell kezelni.

- Az alkalmazást a MapReduce algoritmussal futtatja, ahol az adatokat párhuzamosan dolgozzák fel a különféle CPU-csomópontok. Más szavakkal, a Hadoop keretrendszer elegendő olyan alkalmazások kifejlesztésére, amelyek tovább képesek számítógépes fürtökön futni, és hatalmas mennyiségű adat teljes statisztikai elemzését elvégezhetik.

- A Hadoop magja egy tároló részből áll, amelyet Hadoop elosztott fájlrendszer néven ismert, és a MapReduce programozási modellnek nevezett feldolgozó részből áll. A Hadoop alapvetően felosztja a fájlokat a nagy blokkokra és elosztja azokat a fürtök között, a csomagkódot csomópontokba továbbítja az adatok párhuzamos feldolgozására.

- Ezt a megközelítési adatkészletet gyorsabban és hatékonyabban kell feldolgozni. Más Hadoop modulok a Hadoop általános, ez egy csomó Java könyvtár és segédprogram, amelyeket a Hadoop modulok adtak vissza. Ezek a könyvtárak fájlrendszer és operációs rendszer szintű absztrakciót nyújtanak, a Hadoop elindításához szükséges Java fájlokat és szkripteket is tartalmaznak. A Hadoop fonal egy olyan modul is, amelyet a munka ütemezésére és a fürt erőforrás-kezelésére használnak.

Szikra

- A Spark a Hadoop MapReduce modul tetején épült, és kibővíti a MapReduce modellt, hogy hatékonyan használjon több típusú számítást, beleértve az interaktív lekérdezéseket és az adatfeldolgozást. A Sparkot az Apache szoftver alapítvány vezette be, hogy felgyorsítsa a Hadoop számítástechnikai szoftver folyamatát.

- A Spark saját fürtkezeléssel rendelkezik, és nem a Hadoop módosított verziója. A Spark kétféle módon használja ki a Hadoopot - az egyik a tárolás, a második pedig a feldolgozás. Mivel a fürtkezelés maga a Sparkból érkezik, ezért a Hadoop programot csak tárolási célokra használja.

- A Spark a Hadoop egyik alprojektje, amelyet 2009-ben fejlesztettek ki, majd később nyílt forrásúvá vált BSD licenc alapján. Sok csodálatos funkcióval rendelkezik, bizonyos modulok módosításával és új modulok beépítésével. Segít egy alkalmazás futtatásában egy Hadoop-fürtben, többször gyorsabban a memóriában.

- Ez azáltal lehetséges, hogy a lemezre történő írási / írási műveletek számát csökkentik. A közbenső feldolgozási adatokat tárolja a memóriában, az olvasási / írási műveletek mentésével. A Spark beépített API-kat is kínál Java, Python vagy Scala nyelven. Így az alkalmazások többféle módon is írhatók. A Spark nemcsak Map and Reduce stratégiát nyújt, hanem támogatja az SQL lekérdezéseket, adatfolyam-adatátvitelt, gépi tanulást és grafikus algoritmusokat is.

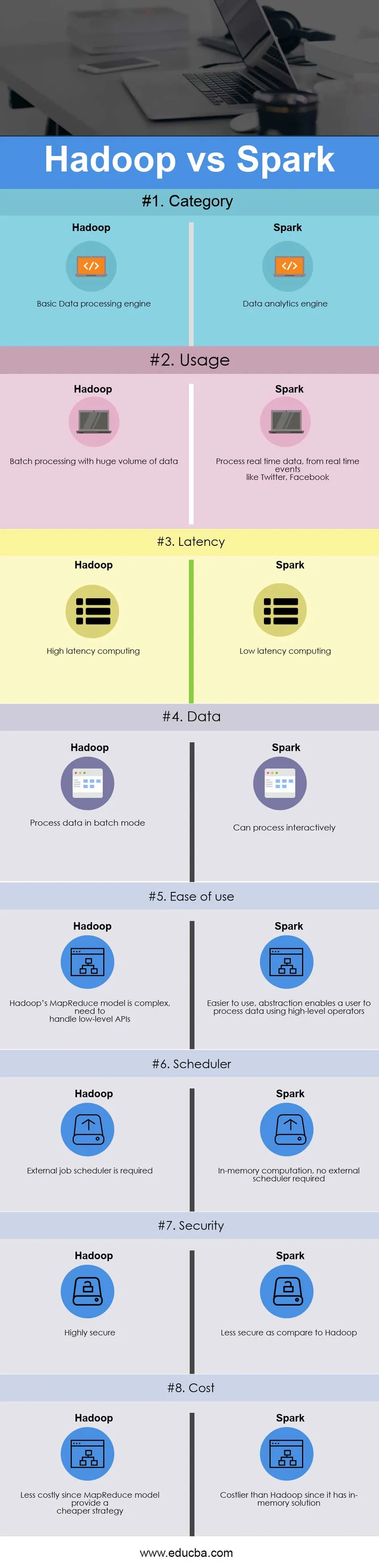

A fej és a fej összehasonlítása a Hadoop és a Spark között (Infographics)

Az alábbiakban a 8. legfontosabb különbség a Hadoop és Spark között

A Hadoop és Spark közötti különbségek

Mindkét Hadoop vs Spark népszerű választás a piacon; beszéljünk a Hadoop és a Spark közötti különbségről:

- A Hadoop egy nyílt forráskódú keret, amely MapReduce algoritmust használ, míg a Spark villámgyors fürtszámítási technológia, amely kiterjeszti a MapReduce modellt arra, hogy hatékonyabban felhasználhassa több típusú számításnál.

- A Hadoop MapReduce modellje leolvassa és írja a lemezt, ezáltal lelassítja a feldolgozási sebességet, míg a Spark csökkenti az olvasási / írási ciklusok számát a lemezen és a közbenső adatok tárolását a memóriában, ezáltal gyorsabb a feldolgozási sebesség.

- A Hadoop a fejlesztőktől megköveteli a kódolást minden egyes műveletnél, míg a Spark könnyen programozható az RDD - Resilient Distributed Dataset segítségével.

- A Hadoop MapReduce modell kötegelt motort biztosít, így más követelményektől függ a különféle motoroktól, míg a Spark kötegelt, interaktív, gépi tanulást és streaming-et hajt végre ugyanazon a fürtön.

- A Hadoop célja a kötegelt feldolgozás hatékony kezelése, míg a Spark célja a valós idejű adatok hatékony kezelése.

- A Hadoop magas késleltetésű számítási keret, amely nem rendelkezik interaktív móddal, míg a Spark alacsony késleltetésű számítástechnika és interaktív módon képes feldolgozni az adatokat.

- A Hadoop MapReduce segítségével a fejlesztő csak kötegelt módban dolgozhat fel az adatokkal, míg a Spark valósidejű adatokat képes feldolgozni a Spark Streaming segítségével.

- A Hadoop a hibák és meghibásodások kezelésére lett kifejlesztve, természetesen rugalmas a hibákkal szemben, így rendkívül hibatűrő rendszer, míg a Spark esetén az RDD lehetővé teszi a partíciók helyreállítását a meghibásodott csomópontokon.

- A Hadoopnak például külsõ feladatok ütemezésére van szüksége - Oozie az összetett folyamatok ütemezésére, míg a Spark rendelkezik a memóriában történõ kiszámítással, tehát saját áramlási ütemezõvel rendelkezik.

- A Hadoop olcsóbb opció, miközben összehasonlítja azt a költség szempontjából, míg a Spark sok memóriát igényel a memória futtatásához, ezáltal növelve a klasztert és ezzel a költségeket.

Hadoop vs Spark összehasonlító táblázat

Az alábbiakban tárgyaljuk a Hadoop és a Spark elsődleges összehasonlítását

| A Hadoop és a Spark összehasonlításának alapjai |

Hadoop |

Szikra |

| Kategória | Alapvető adatfeldolgozó motor | Adatanalitikai motor |

| Használat | Kötegelt feldolgozás hatalmas adatmennyiséggel | Feldolgozza a valós idejű adatokat olyan valós idejű eseményekből, mint a Twitter, a Facebook |

| Késleltetés | Magas késleltetésű számítás | Alacsony késleltetésű számítás |

| Adat | Az adatok feldolgozása kötegelt módban | Interaktív módon képes feldolgozni |

| Egyszerű használat | A Hadoop MapReduce modellje összetett, alacsony szintű API-kat kell kezelni | A könnyebb használat, az absztrakció lehetővé teszi a felhasználó számára az adatok feldolgozását magas szintű operátorok segítségével |

| Scheduler | Külső feladatütemező szükséges | A memóriában történő számításhoz nincs szükség külső ütemezőre |

| Biztonság | Rendkívül biztonságos | Kevésbé biztonságos, mint a Hadoophoz képest |

| Költség | Olcsóbb, mivel a MapReduce modell olcsóbb stratégiát kínál | Drágább, mint a Hadoop, mivel rendelkezik memóriában lévő megoldással |

Következtetés - Hadoop vs Spark

A Hadoop MapReduce nagy mennyiségű adat párhuzamos feldolgozását teszi lehetővé. Egy nagy darabot kisebb részekre oszt, hogy külön adatcsomópontokon külön dolgozzon fel, és automatikusan összegyűjti az eredményeket a több csomóponton, hogy egyetlen eredményt kapjon. Ha a kapott adathalmaz nagyobb, mint a rendelkezésre álló RAM, a Hadoop MapReduce felülmúlhatja a Spark-ot.

A Spark viszont könnyebben használható, mint a Hadoop, mivel a felhasználóbarát API-khoz tartozik a Scala (anyanyelve), a Java, a Python és a Spark SQL számára. Mivel a Spark lehetővé teszi az adatfolyam, a kötegelt feldolgozás és a gépi tanulás végrehajtását ugyanabban a fürtben, a felhasználóknak könnyű egyszerűsíteni az adatfeldolgozási infrastruktúrájukat.

A Hadoop és Spark közötti választás végső döntése az alapvető paramétertől - követelménytől - függ. Az Apache Spark sokkal fejlettebb fürtszámítógép, mint a Hadoop MapReduce, mivel bármilyen típusú igényt képes kezelni, azaz kötegelt, interaktív, iteratív, streaming stb., Míg a Hadoop csak a kötegelt feldolgozásra korlátozza. Ugyanakkor a Spark drágább, mint a Hadoop, a memóriában levő funkcióval, amely végül sok RAM-ot igényel. A nap végén mindent a vállalkozás költségvetése és funkcionális igénye határoz meg. Remélem, most már igazságosabb elképzelésed lehet a Hadoop vs Sparkról.

Ajánlott cikk

Ez egy útmutató a Hadoop és Spark közötti különbséghez. Itt is megvitatjuk a Hadoop vs Spark kulcsfontosságú különbségeket az infographics és az összehasonlító táblázat segítségével. A következő Hadoop vs Spark cikkeket is megnézheti további információkért.

- Adatraktár vs Hadoop

- Splunk vs Spark

- Hadoop vs Cassandra - 17 félelmetes különbség

- Pig vs Spark - melyik a jobb

- Hadoop vs SQL teljesítmény: Különbség