Mi a fellendítő algoritmus?

A növelés az az algoritmus, amely a gyenge tanulókat erős tanulókká alakítja. Ez egy olyan módszer, amely új modelleket ad hozzá a meglévő modellek hibáinak kijavításához.

Példa:

Megértjük ezt a fogalmat a következő példa segítségével. Vegyünk egy példát az e-mailről. Hogyan fogja felismerni e-mailjét spamről vagy sem? A következő feltételekkel felismerhető:

- Ha egy e-mail sok forrást tartalmaz, akkor ez spam.

- Ha az e-mail csak egy fájlképet tartalmaz, akkor spam.

- Ha egy e-mailben szerepel egy „Önnek egy xxxxx dolláros lottó tulajdonosa” üzenet, az azt jelenti, hogy spam.

- Ha egy e-mail tartalmaz valamilyen ismert forrást, akkor nem spam.

- Ha olyan hivatalos domaint tartalmaz, mint például az educationba.com, stb., Az azt jelenti, hogy nem spam.

A fent említett szabályok nem annyira hatalmasak a spam felismerésére, vagy sem, ezért ezeket a szabályokat gyenge tanulónak hívják.

A gyenge tanuló erős tanulóvá történő átalakításához a következő módszerekkel kombinálja a gyenge tanuló előrejelzését.

- Átlagos vagy súlyozott átlag felhasználásával.

- Vegye figyelembe, hogy az előrejelzés nagyobb szavazattal rendelkezik.

Vegye figyelembe a fent említett 5 szabályt: 3 szavazat van a spamről és 2 szavazat a nem spamről. Mivel magas a szavazati spam, spamnek tekintjük.

Hogyan működik a javító algoritmusok?

A növelő algoritmusok egyesítik a gyenge tanulókat egy erős előrejelzési szabály létrehozására. A gyenge szabály azonosításához létezik egy alapvető tanulási algoritmus (Machine Learning). Amikor az Base algoritmust alkalmazzák, új előrejelzési szabályokat hoz létre az iterációs folyamat felhasználásával. Néhány iteráció után az összes gyenge szabályt egyesíti, hogy egyetlen predikciós szabályt hozzon létre.

A helyes elosztás kiválasztásához kövesse az alább említett lépéseket:

1. lépés: Az alaptanulási algoritmus egyesíti az egyes eloszlásokat, és egyenlő súlyt alkalmaz minden egyes eloszláshoz.

2. lépés: Ha valamilyen előrejelzés történik az első alaptanulási algoritmus során, akkor nagy figyelmet szentelünk erre az előrejelzési hibára.

3. lépés: Ismételje meg a 2. lépést, amíg el nem éri az Alaptanulási algoritmus korlátját vagy a nagy pontosságot.

4. lépés: Végül egyesíti az összes gyenge tanulót, hogy egy erős jóslat jöjjön létre.

A fellendítő algoritmus típusai

A javító algoritmusok különféle motorokat használnak, például döntési bélyegzőt, margó maximalizáló osztályozási algoritmust stb. Háromféle erősítő algoritmus létezik, amelyek a következők:

- AdaBoost (Adaptive Boosting) algoritmus

- Színátmenet-növelő algoritmus

- XG Boost algoritmus

AdaBoost (Adaptive Boosting) algoritmus

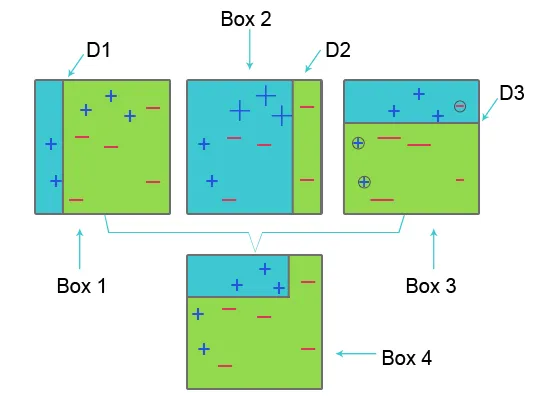

Az AdaBoost megértéséhez kérjük, olvassa el az alábbi képet:

1. rovat: Az 1. rovatban minden adatkészlethez egyenlő súlyokat rendelünk, és a plusz (+) és mínusz (-) jel osztályozásához a D1 döntési csonkot alkalmazzuk, amely függőleges vonalat hoz létre az 1. rovat bal oldalán. Ez a sor helytelenül előrejelzett három pluszjelet (+) mint mínusz (-), ezért nagyobb tömegeket alkalmazunk ezekre a pluszjelekre, és egy másik döntési csonkot alkalmazunk.

2. rovat: A 2. rovatban a három helytelenül előrejelzett pluszjel (+) mérete nagyobb lesz, mint egy másik. A második D2 döntési csonk a blokk jobb oldalán megjósolja ezt a helytelenül megjósolt pluszjel (+) jelet helyesnek. Mivel azonban téves osztályozási hiba történt a mínuszjel (-) egyenlőtlen súlya miatt, nagyobb súlyt rendelünk a (-) mínuszjelhez, és egy másik döntési csonkot alkalmazunk.

3. rovat: A harmadik rovatban a téves osztályozási hiba miatt a három mínusz jel (-) nagy súlyú. itt a D3 döntési csonkot alkalmazzák ennek a téves osztályozásnak a előrejelzésére és kijavítására. Ezúttal létrejön a vízszintes vonal plusz (+) és mínusz (-) jel osztályozására.

4. háttérmagyarázat: A 4. rovatban a D1, D2 és D3 döntési csontok kombinálódnak egy új, erős előrejelzés létrehozásához.

Az adaptív emlékeztető munkák hasonlóak a fentiekhez. Egyesíti a gyenge tanulócsoportot a súlykor alapján, hogy erős tanuló legyen. Az első iterációban egyenlő súlyt ad az egyes adatkészleteknek, és megkezdődik az adatkészlet előrejelzése. Ha helytelen előrejelzés történik, akkor az jelentős megfigyelést jelent. Az adaptív erősítés ismételje meg ezt az eljárást a következő iterációs szakaszban, és folytassa mindaddig, amíg a pontosság el nem érkezik. Ezután egyesíti ezt egy erős előrejelzés létrehozásához.

Színátmenet növelő algoritmus

A gradiensnövelő algoritmus gépi tanulási módszer a veszteségfüggvény meghatározására és csökkentésére. A besorolási problémák predikciós modellek segítségével történő megoldására szolgál. A következő lépéseket tartalmazza:

1. Loss Function

A veszteség funkció használata a probléma típusától függ. A gradiensnövelés előnye, hogy nincs szükség új fokozó algoritmusra minden veszteségfüggvényhez.

2. Gyenge tanuló

A gradiens fokozásakor a döntési fákat gyenge tanulóként használják. A regressziós fa valódi értékek megadására szolgál, amelyeket össze lehet kombinálni a helyes előrejelzések létrehozásához. Mint az AdaBoost algoritmusban, kisméretű, egyetlen osztással rendelkező fákat is használnak, azaz döntési csonkot. A nagyobb fákat nagy i, e 4-8 szinteknél használják.

3. Kiegészítő modell

Ebben a modellben a fákat egyenként adják hozzá. a meglévő fák változatlanok maradnak. A fák hozzáadása során a gradiens leszállást használják a veszteség funkció minimalizálására.

XG Boost

Az XG Boost rövidítése az Extreme Gradient Boosting-nak. Az XG Boost a Gradient Boosting Algorithm továbbfejlesztett megvalósítása, amelyet nagy számítási sebesség, méretezhetőség és jobb teljesítmény érdekében fejlesztettek ki.

Az XG Boost különféle funkciókkal rendelkezik, amelyek a következők:

- Párhuzamos feldolgozás: Az XG Boost párhuzamos feldolgozást biztosít a faépítéshez, amely CPU-magokat használ edzés közben.

- Kereszt-érvényesítés: Az XG Boost lehetővé teszi a felhasználók számára, hogy minden egyes iterációnál elvégezzék a fellendítő folyamat kereszt-validálását, megkönnyítve ezzel a frekvencianövelő iterációk pontos optimális számának elérését egy futtatás során.

- Gyorsítótár-optimalizálás: Biztosítja az algoritmusok gyorsítótár-optimalizálását a nagyobb végrehajtási sebesség érdekében.

- Elosztott számítástechnika : Nagy modellek kiképzéséhez az XG Boost lehetővé teszi az elosztott számítástechnikát.

Ajánlott cikkek

Ebben a cikkben láttuk, hogy mi a fellendítő algoritmus, a gépi tanulás fellendítésének különféle típusai és azok működése. A további javasolt cikkeken keresztül további információkat is megtudhat -

- Mi a gépi tanulás? | Meghatározás

- Programozási nyelvek az algoritmusok tanulásához

- Mi a Blockchain technológia?

- Mi az algoritmus?