Bevezetés a zsákoláshoz és növeléshez

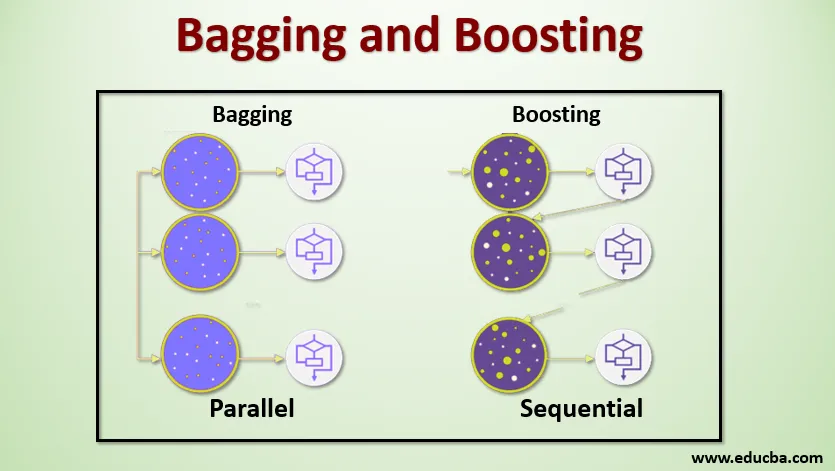

A csomagolás és a növelés a két népszerű együttes módszer. Tehát, mielőtt megértjük a csomagolást és a növelést, nézzük meg, mi az az együttes tanulás. Az a módszer, amikor több tanulási algoritmust használnak modellek azonos adatkészlettel való továbbképzésére, hogy megjósolja a gépi tanulást. Miután megkaptuk az előrejelzést az egyes modellekről, modell átlagolási technikákat fogunk használni, például súlyozott átlagot, varianciát vagy max szavazást a végső előrejelzés megkapásához. Ennek a módszernek az a célja, hogy jobb előrejelzéseket szerezzen, mint az egyedi modell. Ez jobb pontosságot eredményez, elkerülve a túlfűtést, és csökkenti az torzítást és az eltérést. Két népszerű együttes módszer:

- Csomagolás (Bootstrap összeszerelés)

- fellendítése

Zsákolás:

A zsákolás, más néven Bootstrap Aggregating, a pontosság javítására szolgál, és a modellt általánosabbá teszi a variancia csökkentésével, azaz a túlzott felszerelés elkerülésével. Ebben a képzési adatkészlet több részhalmazát vesszük. Mindegyik részhalmazhoz ugyanazokkal a tanulási algoritmusokkal mintát veszünk, mint például a Döntési fa, a Logisztikai regresszió stb., Hogy megjósoljuk a kimenetet ugyanazon tesztadatok számára. Ha már megvan egy előrejelzés az egyes modellekről, akkor egy modell átlagolási technikát alkalmazunk a végső előrejelzési eredmény elérésére. Az egyik legismertebb módszer a csomagolásban a Random Forest . A Véletlenszerű erdőben több döntési fát használunk.

Fokozás :

A javítást elsősorban a felügyelt tanulási technika torzulásának és eltérésének csökkentésére használják. Ez egy olyan algoritmus családjára vonatkozik, amely a gyenge tanulókat (alaptanulókat) erős tanulókká alakítja. A gyenge tanuló olyan osztályozók, amelyek csak kis mértékben helyesek a tényleges osztályozásban, míg az erős tanulók azok a osztályozók, amelyek jól korrelálnak a tényleges osztályozással. A Boosting néhány híres technikája az AdaBoost, a GRADIENT Boosting, az XgBOOST (Extreme Gradient Boosting). Tehát most tudjuk, mi a csomagolás és a fellendülés, és mi a szerepe a gépi tanulásban.

Csomagolás és növelés működése

Most nézzük meg, hogyan működik a csomagolás és a fokozás:

Zsákolás

A Bagging működésének megértéséhez tegyük fel, hogy N modellszámmal és D adatkészlettel rendelkezik. Ahol m az adatok száma és n az egyes adatok jellemzőinek száma. És bináris osztályozást kellene végeznünk. Először felosztjuk az adatkészletet. Jelenleg ezt az adatkészletet csak képzési és tesztkészletre osztjuk. Hívjuk az edzési adatállományt, ahol az összes edzési példa található.

Vegyünk egy mintát az edzőkészletből, és használd az első modell, azaz m1 kiképzéséhez. A következő modellhez a m2 mintát állítson be az edzőkészlethez, és vegyen újabb mintát az edzőkészletből. Ugyanezt fogjuk csinálni az N számú modellnél. Mivel újból mintát állítunk az edzési adatkészletre, és mintákat veszünk belőle anélkül, hogy az adatkészletből bármit eltávolítanánk, lehetséges, hogy két vagy több edzési adatrekord van több mintában. Az edzési adatállomány újbóli mintavételének és a modellnek a modellnek való továbbításának ezt a technikáját sormintának pótolással nevezzük. Tegyük fel, hogy kiképeztük az egyes modelleket, és most meg szeretnénk látni az előrejelzést a teszt adatain. Mivel a bináris osztályozáson dolgozunk, 0 vagy 1 lehet. A teszt adatkészletet továbbítják minden modellhez, és minden modellből megkapunk egy előrejelzést. Tegyük fel, hogy az N modell közül az N / 2 modelleknél többet jósoltak 1-nek, ennélfogva a modell átlagolási módszerrel, például a maximális szavazattal, azt mondhatjuk, hogy a teszt adatok várható kimenete 1.

fellendítése

A javítás során az adatkészletből nyilvántartásokat veszünk, és egymás után továbbadjuk az alapvető tanulóknak, itt az alaptanuló bármilyen modell lehet. Tegyük fel, hogy m számú rekord van az adatkészletben. Ezután átadunk néhány rekordot a BL1 tanuló alapjához és edzéséhez. Amint a BL1 kiképződik, átadjuk az összes adatot az adatkészletből, és megnézhetjük, hogyan működik az alaptanuló. Az összes olyan rekordhoz, amelyet az alaptanuló hibásan besorol, csak azt vesszük át, és átadjuk egy másik alaptanulónak, mondjuk BL2, és ezzel egyidejűleg átadjuk a BL2 által osztályozott hibás rekordokat az BL3 kiképzéséhez. Ez addig folytatódik, amíg és amíg nem határozunk meg egy bizonyos számú alapszintű tanulói modellt, amelyre szükségünk van. Végül összevonjuk ezen alaptanulók eredményeit, és erős tanulókat hozunk létre, amelynek eredményeként a modell előrejelzési képessége javul. Rendben. Tehát most már tudjuk, hogyan működik a csomagolás és a feltöltődés.

A csomagolás és a feltöltés előnyei és hátrányai

Az alábbiakban felsoroljuk a legfontosabb előnyöket és hátrányokat.

A csomagolás előnyei

- A csomagolás legnagyobb előnye, hogy több gyenge tanuló jobban működhet, mint egy erős tanuló.

- Stabilitást biztosít és növeli a statisztikai osztályozásban és regresszióban használt gépi tanulási algoritmus pontosságát.

- Segít a variancia csökkentésében, azaz elkerüli a túlfűtést.

A csomagolás hátrányai

- Erõs torzítást eredményezhet, ha nem megfelelõen modellezve, így alulteljesítéshez vezethet.

- Mivel több modellt kell használnunk, számítási szempontból drága lesz, és lehet, hogy nem alkalmas különféle felhasználási esetekre.

A növekedés előnyei

- Ez az egyik legsikeresebb módszer a két osztályú osztályozási problémák megoldására.

- Jó a hiányzó adatok kezelése.

A fellendülés hátrányai

- A javítást valós időben nehéz végrehajtani az algoritmus megnövekedett összetettsége miatt.

- Ennek a technikának a nagy rugalmassága több paramétert eredményez, mint amelyek közvetlenül befolyásolják a modell viselkedését.

Következtetés

A fő elvitel az, hogy a csomagolás és a növelés olyan gépi tanulási paradigma, amelyben több modellt alkalmazunk ugyanazon probléma megoldására és a jobb teljesítmény elérésére. És ha megfelelően összevonjuk a gyenge tanulókat, akkor stabil, pontos és robusztus modellt kaphatunk. Ebben a cikkben áttekintést adtam a csomagolásról és a töltésről. A következő cikkekben megismerheti a mindkettőben alkalmazott különböző technikákat. Végül befejezzem, emlékeztetve önöket, hogy a Bagging és a Boosting az együttes tanulásának leggyakrabban használt technikái. A teljesítmény javításának valódi művészete abban rejlik, hogy megértette, mikor kell használni a modellt, és hogyan kell beállítani a hiperparamétereket.

Ajánlott cikkek

Ez egy útmutató a csomagoláshoz és a növekedéshez. Itt tárgyaljuk a becsomagolás és növelés bevezetését, valamint az előnyeinek és hátrányainak a működését. A további javasolt cikkeken keresztül további információkat is megtudhat -

- Bevezetés az együttes technikájába

- Gépi tanulási algoritmusok kategóriái

- Színátmenet-növelő algoritmus mintakóddal

- Mi a fellendítő algoritmus?

- Hogyan hozhatunk létre döntési fát?