Bevezetés a korlátozott Boltzmann gépbe

A korlátozott Boltzmann gép olyan módszer, amely automatikusan megtalálja az adatok mintáit a bemenet rekonstruálásával. Geoff Hinton a mély tanulás alapítója. Az RBM egy felületes kétrétegű hálózat, amelyben az első látható, a következő pedig a rejtett réteg. A látható réteg minden egyes csomópontja csatlakozik a rejtett réteg minden egyes csomópontjához. A korlátozott Boltzmann-gépet korlátozottnak tekintjük, mivel ugyanazon réteg két csomópontja nem képez kapcsolatot. Az RBM a kétirányú fordító numerikus egyenértéke. Az előremeneti úton az RBM fogadja a bemenetet, és átalakítja azt a bemenetet kódoló számkészletre. A hátrányos úton ezt eredményezve feldolgozza, és feldolgozza ezt a bemeneti halmazt, és fordítva fordítja le őket, hogy visszahúzott bemeneteket képezzen. Egy szuperképzett hálózat képes lesz ezt a fordított átmenetet nagy pontossággal végrehajtani. Két lépésben a súly és az értékek nagyon fontos szerepet játszanak. Lehetővé teszik az RBM-nek a bemenetek közötti kapcsolatok dekódolását, és segítik az RBM-et abban is, hogy eldöntsék, mely bemeneti értékek a legfontosabbak a helyes kimenetek észlelésében.

Korlátozott Boltzmann gép működése

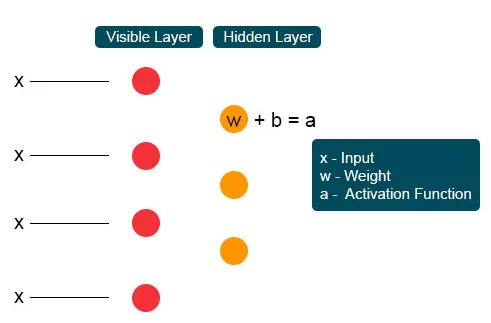

Minden látható csomópont alacsony szintű értéket kap az adatkészlet csomópontjától. A láthatatlan réteg első csomópontjában X-et egy súlytermék alkotja, és hozzáfeszíti. Ennek a folyamatnak az eredménye az aktiválás, amely előállítja az adott bemeneti jel vagy a csomópont kimenetének teljesítményét.

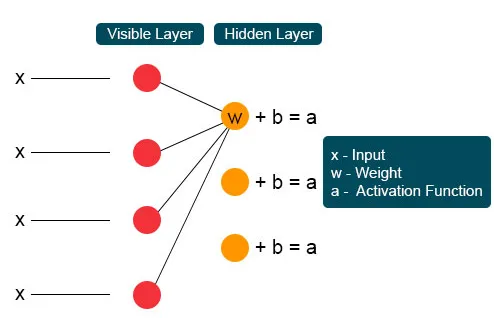

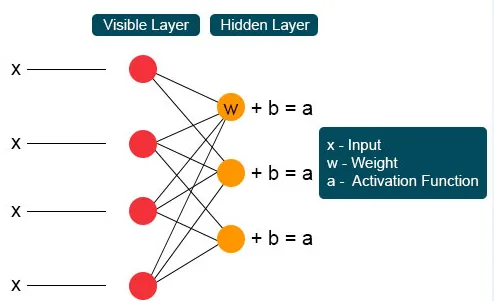

A következő folyamatban több bemenet csatlakozna egyetlen rejtett csomóponthoz. Mindegyik X-et az egyedi súly kombinálja, a termék hozzáadását az értékekhez keverjük, és az eredményt ismét aktiválás útján adjuk át, hogy megkapjuk a csomópont eredményét. Minden láthatatlan csomóponton minden X bemenetet egyesít a W egyedi súly. Az X bemenetnek három súlya van, tizenkét együtt. A réteg között kialakított súly tömbré válik, ahol a sorok pontosságra kerülnek a bemeneti csomópontokra, és az oszlopok elégedettek a kimeneti csomópontokra.

Minden láthatatlan csomópont négy választ kap, súlyozva. E hatás hozzáadása ismét hozzáadja az értéket. Ez katalizátorként szolgál az aktiválási folyamatok bekövetkezéséhez, és az eredményt ismét az aktiválási algoritmushoz adják, amely minden egyes kimenetet előállít minden egyes láthatatlan bemenethez.

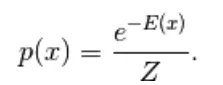

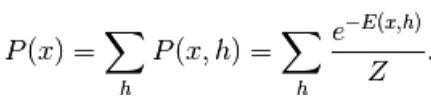

Az itt leírt első modell az energiaalapú modell. Ez a modell a skaláris energiát a változó minden konfigurációjával társítja. Ez a modell az alábbiak szerint határozza meg az energiafüggvény valószínűség-eloszlását:

(1)

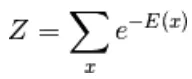

Itt Z a normalizáló tényező. A partíció függvénye a fizikai rendszerek szempontjából

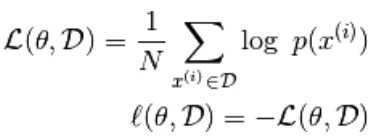

Ebben az energiaalapú függvény egy logisztikai regressziót követ, amely szerint az első lépés meghatározza a log-ot. valószínűség és a következő meghatározza a veszteségfunkciót negatív valószínűségnek.

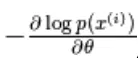

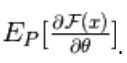

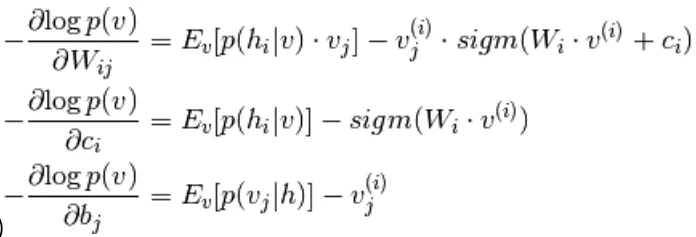

a sztochasztikus gradienst használva,  hol

hol  a paraméterek,

a paraméterek,

az energiaalapú modell rejtett egységet „h” -ként definiálja

A megfigyelt részt „x” -nel jelöljük

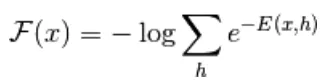

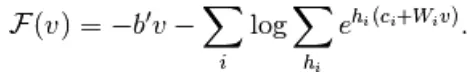

Az (1) egyenletből az F (x) szabad energia egyenletét a következőképpen határozzuk meg

(2)

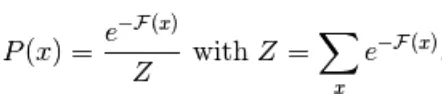

(3)

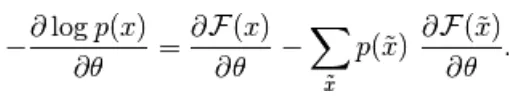

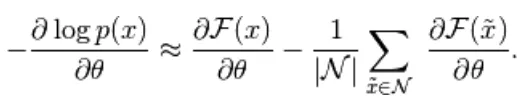

A negatív gradiens formája a következő:

(4)

A fenti egyenletnek két formája van: a pozitív és a negatív. A pozitív és negatív kifejezést az egyenletek jelei nem képviselik. Megmutatják a valószínűségi sűrűség hatását. Az első rész a megfelelő szabad energia csökkentésének valószínűségét mutatja. A második rész a minták előállítási valószínűségének csökkentését mutatja. Ezután a gradienst az alábbiak szerint határozzuk meg:

(5)

Itt N negatív részecskék. Ebben az energiaalapú modellben nehéz a gradienst analitikusan meghatározni, mivel ez magában foglalja a

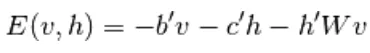

Ezért ebben az EBM modellben olyan lineáris megfigyelés van, amely nem képes az adatokat pontosan ábrázolni. Tehát a következő, korlátozott Boltzmann gépben a rejtett rétegnek nagyobb a pontossága és az adatvesztés megakadályozása. Az RBM energia funkciója a következő,

(6)

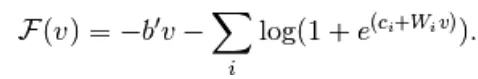

Itt W a látható és a rejtett rétegek közötti összeköttetés. b eltolódik a látható rétegtől. c elrejti a rejtett réteget. szabad energiává alakítva,

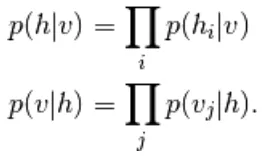

Az RBM-ben a látható és a rejtett réteg egységei teljesen függetlenek, amelyeket a következőképpen lehet írni:

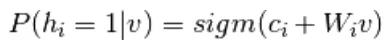

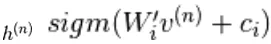

A 6. és 2. egyenletből a neuron aktivációs függvény valószínű változata,

(7)

(8)

Ezt tovább egyszerűsítik

(9)

Az 5. és 9. egyenletet kombinálva,

(10)

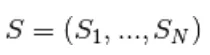

Mintavétel korlátozott Boltzmann gépen

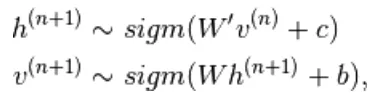

N véletlen változó ízületének Gibbs-mintavétele  az űrlap N mintavételi allépéseinek sorozatán keresztül történik

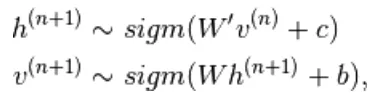

az űrlap N mintavételi allépéseinek sorozatán keresztül történik  hol

hol

tartalmaz  a többi véletlen változó

a többi véletlen változó  kizárás.

kizárás.

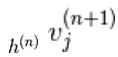

Az RBM-ben az S látható és rejtett egységek halmaza. A két rész független, amely képes végrehajtani vagy blokkolni a Gibbs mintavételt. Itt a látható egység mintavételt végez és rögzített értéket ad a rejtett egységeknek, ezzel egyidejűleg a rejtett egységek rögzített értékeket szolgáltatnak a látható egységnek mintavétel útján

itt,  az összes rejtett egység halmaza.

az összes rejtett egység halmaza.  Egy példa

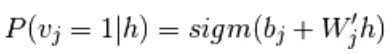

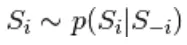

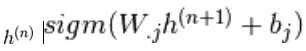

Egy példa  véletlenszerűen úgy választják meg, hogy 1 (versus 0) valószínűséggel,

véletlenszerűen úgy választják meg, hogy 1 (versus 0) valószínűséggel,  és hasonlóképpen

és hasonlóképpen  véletlenszerűen 1-re (0-val szemben) választják valószínűséggel

véletlenszerűen 1-re (0-val szemben) választják valószínűséggel

Kontrasztív divergencia

Katalizátorként használják a mintavételi folyamat felgyorsítására

Mivel azt várjuk, hogy igaz legyen, elvárjuk  az eloszlási értéknek P-hez közel kell lennie, hogy ez konvergenciát képezzen a P végső eloszlásával

az eloszlási értéknek P-hez közel kell lennie, hogy ez konvergenciát képezzen a P végső eloszlásával

A kontrasztív divergencia azonban nem várja meg a lánc konvergenciáját. A mintát csak Gibb folyamata után nyerjük, tehát itt k = 1-et állítottuk be, ahol meglepően jól működik.

Perzisztens kontrasztív divergencia

Ez egy másik módszer a mintavételi forma közelítésére. Ez egy állandó mintavételi módszer, amely új mintákat von ki a K paramétereinek egyszerű megváltoztatásával.

Korlátozott Boltzmann gép rétegei

A korlátozott Boltzmann-gép két rétegű, sekély ideghálózattal rendelkezik, amelyek egyesítik a mélyhitű hálózatok blokkját. Az első réteg a látható réteg, a másik réteg a rejtett réteg. Minden egység egy csomópontnak nevezett neuronszerű körre utal. A rejtett réteg csomópontjai a látható réteg csomópontjaihoz vannak csatlakoztatva. De ugyanazon réteg két csomópontja nincs összekötve. A korlátozott kifejezés itt a rétegközi kommunikáció hiányát jelenti. Minden csomópont feldolgozza a bemenetet, és sztochasztikusan dönt arról, hogy továbbítja-e a bemenetet vagy sem.

Példák

Az RBM fontos szerepe a valószínűségi eloszlás. A nyelvek egyedi betűkkel és hangokkal. A levél valószínűségi eloszlása lehet magas vagy alacsony. Angolul a T, E és A betűket széles körben használják. De izlandi nyelven a közös betűk az A és a N. nem próbálhatjuk meg rekonstruálni az izlandi nyelvet angol alapján. Ez eltéréshez vezet.

A következő példa a képek. A pixelérték valószínűségi eloszlása az egyes képtípusokonként különbözik. Megfontolhatjuk, hogy két kép van az elefánt és a kutya a vontatási bemeneti csomópontok számára. Az RBM előremenő lépése olyan kérdést generál, mintha erős pixelcsomópontot kellene generálnom az elefántcsomóhoz vagy a kutyacsomóponthoz ?. A visszatekerés olyan kérdéseket vet fel, mint az elefánt, hogyan kell elvárni a pixelek eloszlását? Ezután közös valószínűséggel és a csomópontok által generált aktiválással hálózatot építnek fel, együttes előfordulással, mint a nagy fülek, szürke nemlineáris cső, hajlékony fülek, ráncok az elefánt. Ezért az RBM a mély tanulás és megjelenítés folyamata, amelyek két fő torzítást képeznek, és aktiválásuk és rekonstrukciójuk értelmében hatnak.

A korlátozott Boltzmann gép előnyei

- A korlátozott Boltzmann-gépen alkalmazott algoritmus van az osztályozáshoz, regresszióhoz, téma modellezéséhez, együttműködési szűréshez és a funkció tanulásához.

- A korlátozott Boltzmann-gépet használják a neuro-képezéshez, a ritka kép rekonstrukciójához az aknák tervezésében, valamint a radar célfelismerésében

- Az RBM SMOTE eljárással képes megoldani a kiegyensúlyozatlan adatproblémákat

- Az RBM a hiányzó értékeket Gibb mintavételével találja meg, amelyet az ismeretlen értékek fedezésére alkalmaznak

- Az RBM kijavítja a zajos címkék problémáját a nem korrigált címkeadatokkal és annak rekonstrukciós hibáival

- A nem strukturált problémát egy szolgáltatáskivonóval oldja meg, amely a nyers adatokat rejtett egységekké alakítja.

Következtetés

A mély tanulás rendkívül erőteljes, amely a komplex problémák megoldásának művészete, még mindig fejlesztési és végrehajtási tere van. A szabad változókat gondosan kell konfigurálni. A neurális hálózat mögött meghúzódó ötlet korábban nehéz volt, ám ma a mély tanulás a gépi tanulás és a mesterséges intelligencia lába. Ezért az RBM bepillantást nyújt a hatalmas mélyreható tanulási algoritmusokba. A kompozíció alapegységével foglalkozik, amely fokozatosan sok népszerű architektúrává nőtte ki magát, és széles körben alkalmazta sok nagyüzemi iparban.

Ajánlott cikk

Ez egy útmutató a korlátozott Boltzmann géphez. Itt tárgyaljuk a korlátozott Boltzmann gép működését, mintavételét, előnyeit és rétegeit. Megnézheti további javasolt cikkeinket is, ha többet szeretne megtudni _

- Gépi tanulási algoritmusok

- Gépi tanulási architektúra

- Gépi tanulás típusai

- Gépi tanulási eszközök

- Neurális hálózatok megvalósítása